UE: Nueva regulación de IA

Nueva regulación europea de IA, espero sea fuente de inspiración para nuestras regulaciones al respecto

Esta semana (13/3/2024) finalmente y luego de un largo debate se aprobó la nueva regulación de IA para los países miembros de la Unión Europea, en una votación muy clara, se votó por 523 votos a favor y 46 en contra la nueva normativa. Incluso algunos países, en particular Francia y Alemania que estaban preocupados por el impacto de la regulación fundamentalmente asociados al freno que esta podía presentar a la innovación y emprendimiento, si se incluían normas asociadas a modelos y no sólo a usos, terminaron por aprobar.

Esta noticia, es especialmente relevante para los países de la región, que muchos de ellos se encuentran en procesos de establecer marcos regulatorios de la IA, en algunos casos en algunos casos con ideas bastante malas al respecto, aquí un buen ejemplo.

Objetivo

Como lo declara el documento final el objetivo de la regulación es:

“Establecer un marco jurídico uniforme, en particular para el desarrollo, la introducción en el mercado, la puesta en servicio y el uso de sistemas de inteligencia artificial (sistemas de IA), de conformidad con los valores de la Unión, para promover la adopción de la inteligencia artificial (IA) centrada en el ser humano y digna de confianza, garantizando al mismo tiempo un alto nivel de protección de la salud, la seguridad, los derechos fundamentales consagrados en la Carta de los Derechos Fundamentales de la Unión Europea (la «Carta»), incluidos la democracia, el Estado de Derecho y la protección del medio ambiente, contra los efectos nocivos de los sistemas de IA en la Unión, y para apoyar la innovación”

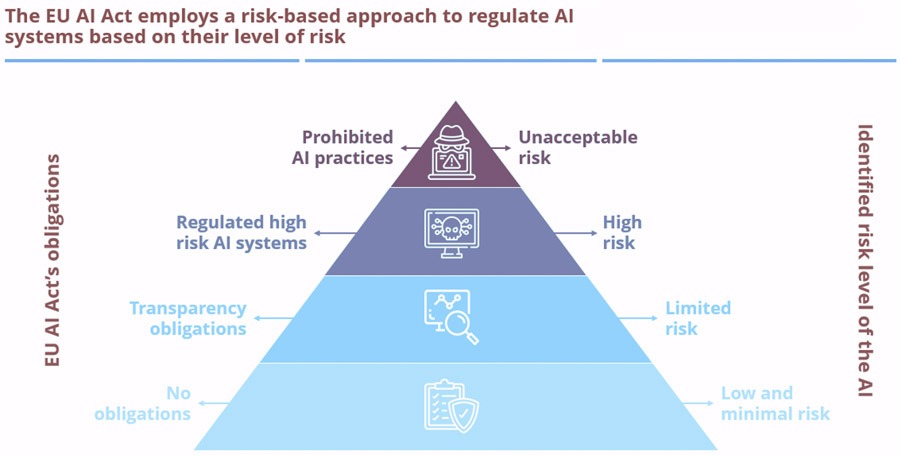

El modelo regulatorio adoptado es uno basado en usos (sus riesgos asociados, esto es, la probabilidad de ocurrencia y el impacto que dicho uso tiene), más que uno vinculado a tecnologías y modelos. Como lo muestra la gráfica siguiente hay 4 niveles (fuente de la gráfica)

Revisemos las más relevantes desde el punto de vista regulatorio, la categoría de uso prohibidos y la de alto riesgo.

Usos prohibidos

Algunos sistemas de IA están prohibidos (los países tendrán 6 meses después de aprobada la ley para aplicarla en sus países), como los que implican:

- Manipulación cognitiva del comportamiento de personas o grupos vulnerables específicos;

- Scoring social, clasificación de personas en función de su comportamiento, estatus socioeconómico o características personales;

- Identificación biométrica y categorización de personas;

- Sistemas de identificación biométrica en tiempo real y a distancia, como el reconocimiento facial.

Sistemas de alto riesgo

Como sistemas de alto riesgo, se plantean algunos ejemplos:

- Infraestructuras críticas (por ejemplo, transporte) que podrían poner en riesgo la vida y la salud de los ciudadanos;

- Formación educativa o profesional que puede determinar el acceso a la educación y el curso profesional de la vida de alguien (por ejemplo, calificación de exámenes);

- Componentes de seguridad de los productos (por ejemplo, aplicación de IA en cirugía asistida por robot);

- Empleo, gestión de trabajadores y acceso al autoempleo (por ejemplo, software de clasificación de CV para procedimientos de contratación);

- Servicios públicos y privados esenciales (por ejemplo, la calificación crediticia que niega a los ciudadanos la oportunidad de obtener un préstamo);

- Aplicación de la ley que pueda interferir en los derechos fundamentales de las personas (por ejemplo, evaluación de la fiabilidad de las pruebas);

- Gestión de la migración, el asilo y el control de fronteras (por ejemplo, examen automatizado de las solicitudes de visado);

- Administración de justicia y procesos democráticos (por ejemplo, soluciones de IA para buscar sentencias judiciales).

¿Qué pasa con IA Generativa?

Muchos se preguntaba que pasaría con los LLM y la inteligencia artificial generativa (ChatGPT, Board, Gemini, Midjourney y Dall-E entre otros) , si bien no quedaron clasificadas como alto riesgo, le pone ciertas exigencias, asociadas a transparencia y protección de derecho de autor.

- Revelar que el contenido ha sido generado por IA;

- Diseñar el modelo para evitar que genere contenidos ilegales;

- Publicar resúmenes de los datos protegidos por derechos de autor utilizados para el entrenamiento.

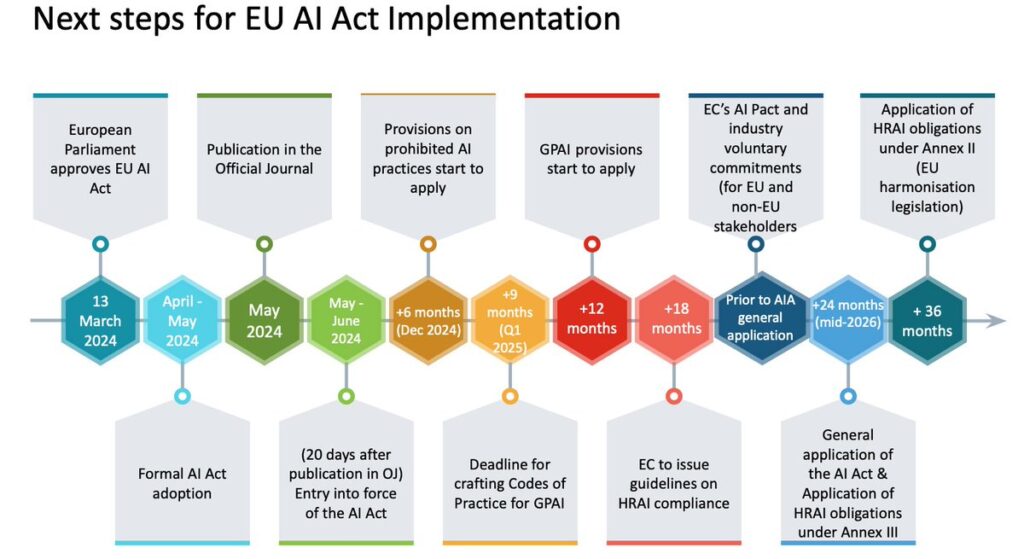

Vigencia y multas

Según el comunicado se espera que se transforme en ley en mayo o junio. Su aplicación es gradual, en dos años debe quedar totalmente operativa.

Las multas establecidas no son menores, pueden alcanzar los 35 millones de euros o el 7% de la facturación anual mundial de la empresa involucrada.

Espero este nuevo marco normativo sea un buen ejemplo a considerar a la hora de regular la IA en estas latitudes.

Gracias por el aporte!

Por nada Rodrigo, gracias por el comentario

Saludos! Recién leo el buen resumen de la Norma. But, dice algo robusto sobre la transparencia activa y obligatoria de los algoritmos de los servicios públicos?. Por mi parte, mientras más leo sobre el tema menos argumentos encuentro para ir más allá de que el propio ciudadano sólo tenga la info de su caso concreto.., (https://www.diarioconstitucional.cl/articulos/confidencialidad-secreto-y-reserva-del-derecho-fundamental-a-la-proteccion-de-datos-personales-2/) 🤷🏻♂️✌🏿