Identificando algunos riesgos de la IA

La Inteligencia Artificial (IA) impone importante desafíos respecto de su uso y como este puede impactar a las personas

El ingreso de la IA en diferentes ámbitos y en particular en procesos de decisión en el Sector Público, ha generado una importante preocupación de diversos sectores, me refiero a la academia y la sociedad civil en lo que dice relación con sesgos y discriminación que esas tecnologías pueden generar a la hora de utilizarlas en procesos de decisión automatizados.

Es por ello, que muchos países se encuentran desarrollando marcos regulatorios y normativas en torno a sus uso.

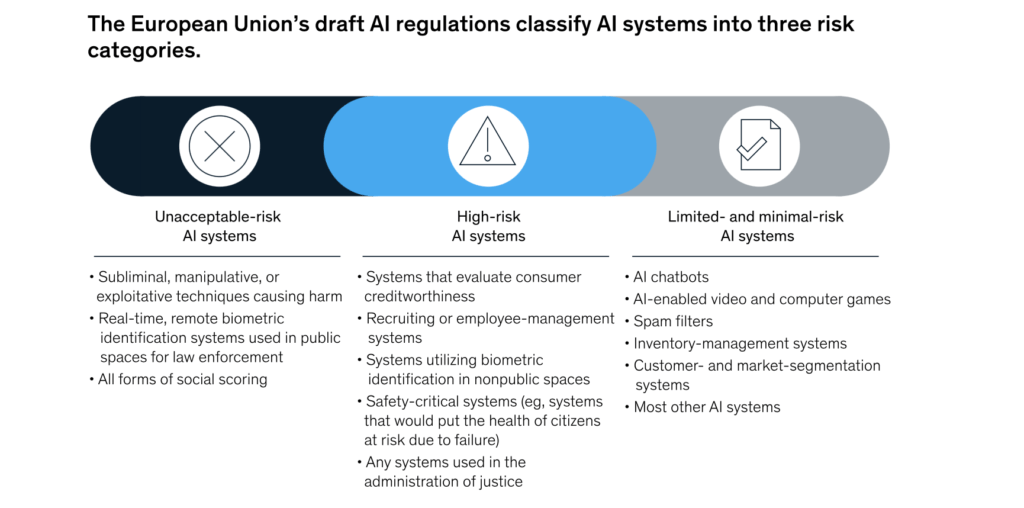

La Unión Europea en los últimos meses he definido un conjunto de normas basadas en un enfoque de riesgos que conllevan los diferentes procesos, para ello identificó cuatro niveles de riesgo, los cuales están asociados a ciertos usos de algunas tecnologías y como estos pueden potencialmente impactar a las personas. Les adjunto una gráfica en la cual la consultora McKinsey en la que categoriza los riesgos

- Riesgo Inaceptable: corresponde a sistemas de inteligencia artificial (IA) que manipulan y/o plantean una amenaza a la seguridad, la vida y los derechos de las personas. En esta área, se incluyen sistemas que manipulan el comportamiento humano y los sistemas que permiten “scoring sociales” por parte de los estados.

- Riesgo Alto: En este nivel se consideran sistemas que plantean un alto riesgo en su uso, algunos de los procesos identificados son: identificación biométrica en espacios públicos, evaluación de créditos, reclutamiento de personal, sistemas de seguridad que puedan impactar en la salud de las personas en caso de falla y finalmente cualquier sistema asociado a la administración de justicia.

- Riesgos Bajo/Limitado: correspondientes a sistemas que implican bajo impacto en las personas, tales como: chatbots, juegos, filtros de spam, gestión de inventarios y marketing entre otros.

Para los sistemas que tengan un nivel de riesgo alto, la Unión Europea recomienda a sus países miembros que se tengan en cuenta las siguientes exigencias:

- Contar con mecanismos adecuados de evaluación y mitigación de riesgos;

- Establecer altos estándares de calidad de los conjuntos de datos utilizados para entrar a los sistemas de forma de reducir los sesgos

- Contar con procesos de registro y trazabilidad de los resultados

- Documentación detallada que proporcione toda la información necesaria sobre el sistema y su finalidad para que las autoridades puedan evaluar su conformidad;

- Información clara y adecuada al usuario;

- Medidas de supervisión humana adecuadas para minimizar el riesgo

Sin perjuicio de lo anterior, el documento plantea serias objeciones respecto de los sistemas de identificación biométrica a distancia, estos están considerado de alto riesgo y deben estar sujetos a requisitos específicos, así como su uso en espacios públicos con fines policiales está prohibido, solo con algunas excepciones: búsqueda de un niño desparecido y amenaza terrorista.

Es de esperar que los actores e involucrados en estas políticas públicas miren con detenimiento los riesgos que en muchos de nuestros países se están asumiendo, sin una adecuada regulación, y que no lleguemos muy tarde

Imagen: Photo by Arno Senoner on Unsplash