IA Generativa, aumentado la productividad científica

Según reciente estudio, los modelos de lenguaje no están empeorando la ciencia, pero sí están eliminando algunas señales que se usaban para evaluar la calidad de la misma. Cuando escribir bien deja de ser costoso, la forma deja de decirnos algo sobre el fondo

Durante mucho tiempo, el lenguaje funcionó como una señal potente en el mundo científico. Un artículo/paper bien escrito —claro, preciso, con un vocabulario técnico adecuado y una estructura sólida— solía ser, en promedio, evaluado como un mejor artículo.

Editores, revisores y comités académicos aprendieron a leer entre líneas y a usar el estilo como un atajo cognitivo para formarse una primera impresión de calidad, pero producto de la IA Generativa esto está cambiando en forma acelerada.

Un reciente estudio publicado en la revista Science, Scientific production in the era of large language models, de académicos de las universidad de Berkeley y Cornell, ofrece evidencia empírica de que los modelos de lenguaje (LLM) están aumentando la productividad científica.

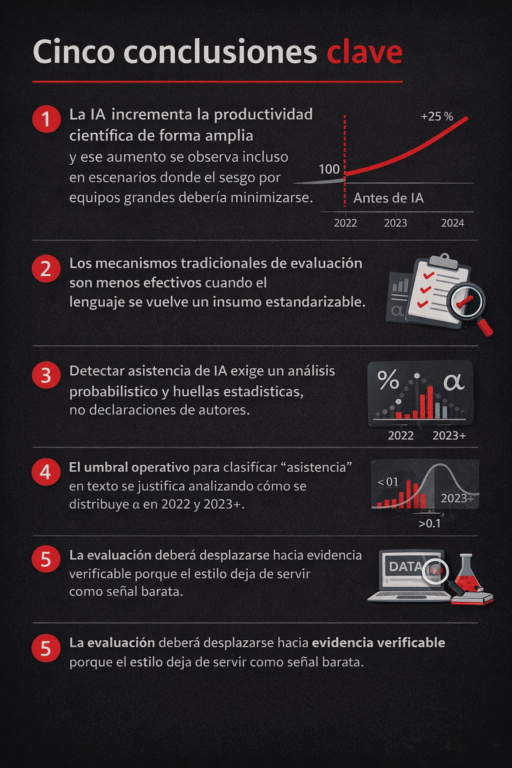

Principales Conclusiones

- La IA aumenta la productividad científica: El uso de modelos de lenguaje reduce fricciones en la escritura académica y permite a los investigadores publicar más. El efecto es consistente entre disciplinas, repositorios y trayectorias profesionales.

- El mayor impacto se da entre quienes estaban en desventaja lingüística: Investigadores no nativos del inglés obtienen mayores beneficios. La IA funciona como una infraestructura invisible que corrige una asimetría estructural del sistema científico global. No cambia quién tiene ideas, pero sí quién logra expresarlas con fluidez aceptable para el circuito académico dominante.

- El lenguaje académico pierde su valor como señal de calidad: Los textos asistidos por IA muestran mayor complejidad léxica, tono más seguro y estilo más pulido. Sin embargo, esos rasgos ya no se traducen en mejores resultados de evaluación. El vínculo histórico entre “buena prosa” y “buena ciencia” se debilita hasta casi desaparecer.

- Los sistemas de evaluación quedan en entredicho: Revisores y editores pierden uno de sus atajos más usados. Cuando todos los textos suenan correctos, sofisticados y convincentes, el lenguaje deja de ayudar a discriminar calidad real. El problema no es que haya más papers malos, sino que hay menos señales útiles para detectarlos.

- El desafío no es ético, es institucional: El estudio no sugiere fraude ni degradación intelectual. Lo que muestra es un desajuste profundo entre tecnologías nuevas y mecanismos de evaluación diseñados para otro mundo. La ciencia enfrenta el mismo dilema que otros sistemas expertos: cuando la forma se automatiza, el fondo exige nuevas formas de validación.

Problemas con las evaluaciones

Los artículos asistidos por IA muestran, de manera sistemática, un lenguaje más elaborado y un vocabulario más sofisticado. En términos puramente formales, estos textos se ven mejor.

Durante décadas, para el ecosistema de publicaciones (revistas científicas, editores, revisores, …) el estilo funcionó como señal porque era costoso. Escribir bien en inglés académico requería tiempo, entrenamiento, dominio conceptual y una inversión significativa de esfuerzo. Esa escasez hacía que la forma del texto transmitiera información sobre el fondo. La llegada de los modelos de lenguaje elimina eso. Cuando todos pueden escribir bien, escribir bien deja de ser una diferencia.

El análisis no mostró que este cambio impactara en la calidad de la ciencia producida, sino algo más sutil y potencialmente más problemático: los evaluadores pierden una fuente de información implícita que usaban, la calidad de la escritura.

La ciencia está empezando a experimentar algo que la educación lleva años anticipando: cuando las señales tradicionales dejan de distinguir esfuerzo, comprensión y calidad, el sistema evaluador se queda sin instrumentos confiables.

Durante décadas, evaluar fue posible porque ciertas habilidades eran costosas. Escribir bien, argumentar con claridad, estructurar ideas complejas, sintetizar bibliografía o resolver problemas sin apoyo externo requería tiempo, entrenamiento y dominio real del contenido. Esas habilidades funcionaban como señales imperfectas, pero útiles. Permitían inferir, con cierto margen de error aceptable, quién entendía y quién no.

Hoy un estudiante de enseñanza media puede entregar un ensayo formalmente impecable sin haber comprendido el texto. Un universitario puede presentar un informe metodológicamente correcto sin haber siquiera leído el método. Un investigador puede producir un abstract sofisticado sin que eso diga nada sobre la solidez de sus resultados. El lenguaje, la forma y la prolijidad dejaron de ser escasos. Y cuando algo deja de ser escaso, deja de informar.

Esto no es un problema ético, ni disciplinario. No se resuelve con prohibiciones ni con detectores.

En educación secundaria ya se observa con claridad: las tareas escritas, los trabajos para la casa y los ensayos dejaron de discriminar aprendizaje real. En educación terciaria ocurre lo mismo con informes, papers simulados y presentaciones conceptualmente correctas pero cognitivamente vacías. La reacción inicial suele ser defensiva —más controles, más vigilancia, más castigo—, pero esa estrategia solo confirma el diagnóstico equivocado: creer que el problema es el uso de IA.

Lo que el estudio sobre ciencia muestra con crudeza es que este fenómeno no se limita al aula. Está ocurriendo en el corazón mismo del sistema de producción de conocimiento. Revisores y editores empiezan a desconfiar de textos “demasiado bien escritos”. Las señales que antes orientaban decisiones ahora generan ruido. La evaluación se vuelve más lenta, más incierta y, paradójicamente, más conservadora.

La consecuencia es incómoda pero inevitable: los sistemas de evaluación basados en forma, estilo y retórica están quedando obsoletos.

Lo que viene no es el fin de la evaluación, sino su transformación. Evaluar pasará menos por la redacción y más por la trazabilidad del razonamiento. Menos por la respuesta correcta y más por la capacidad de explicar, defender, contrastar y replicar.

En educación, eso implica más evaluación en tiempo real, más oralidad, más resolución situada de problemas. En ciencia, más énfasis en datos, código, métodos y resultados verificables.